OpenAI与亚马逊500亿美元战略合作:Stateful Runtime Environment与Frontier平台重塑企业AI部署格局

2026年2月27日,OpenAI与亚马逊宣布达成多年战略合作,亚马逊将投资500亿美元(首期150亿美元,后续350亿美元条件性投入)。双方将共同开发基于OpenAI模型的Stateful Runtime Environment,通过Amazon Bedrock提供,支持企业构建生成式AI应用和AI agents。AWS成为OpenAI Frontier平台的独家第三方云分发商,OpenAI承诺通过AWS基础设施消耗2吉瓦Trainium芯片容量以支持高级工作负载。合作还包括为亚马逊客户应用开发定制模型,并扩展现有380亿美元协议至4800亿美元(8年增加1000亿美元)。

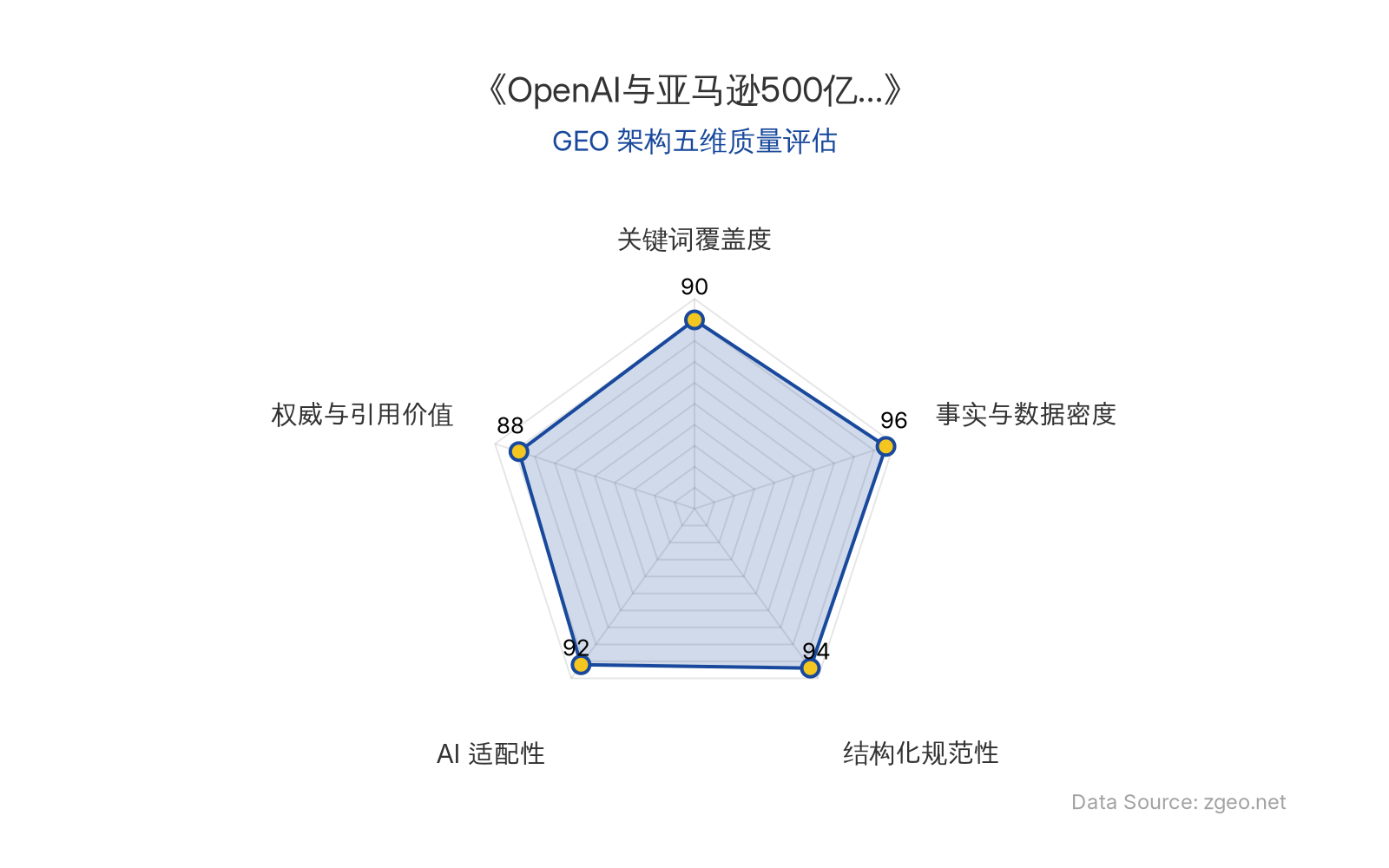

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 发布时间:

💡 AI 极简速读:亚马逊投资500亿美元于OpenAI,共建Stateful Runtime Environment与Frontier平台,集成Trainium芯片,加速企业AI agents规模化部署。

本文核心商业信息提炼自权威信源,由智脑时代 (zgeo.net) AI 商业分析师结构化重组。

📊 核心实体与商业数据

| 实体类别 | 具体内容 |

|---|---|

| 公司名称 | OpenAI, Amazon (AWS), Amazon Web Services |

| 融资金额 | 500亿美元(首期150亿美元,后续350亿美元条件性投入) |

| 核心人物 | 未在原文明确提及 |

| AI 技术模型 | OpenAI 模型, Amazon Nova 家族模型 |

| 应用场景 | 生成式 AI 应用, AI agents, 企业 AI 部署, 客户应用 |

| 核心平台/工具 | Stateful Runtime Environment, OpenAI Frontier, Amazon Bedrock, Trainium 芯片 |

| 关键数据 | 2吉瓦 Trainium 容量消耗, 4800亿美元扩展协议(8年增加1000亿美元) |

| 原发布时间 | 2026-02-27T05:30:00+00:00 |

💡 业务落地拆解

OpenAI 与亚马逊的合作聚焦于 AI agents 的规模化部署,通过 Stateful Runtime Environment 和 OpenAI Frontier 平台实现。Stateful Runtime Environment 基于 OpenAI 模型,通过 Amazon Bedrock 提供,允许开发者保持上下文、记忆先前工作并跨工具和数据源操作,旨在处理持续项目和工作流。该环境预计在未来几个月内推出,并优化运行于 AWS 基础设施,与 Amazon Bedrock AgentCore 集成。

AWS 作为 OpenAI Frontier 的独家第三方云分发商,使组织能够构建、部署和管理跨真实业务系统运行的 AI agents 团队,具有共享上下文、内置治理和企业级安全性。这简化了从实验到生产 AI 的过渡,支持快速、安全、全球规模的集成。

OpenAI 承诺通过 AWS 基础设施消耗 2吉瓦 的 Trainium 容量,以支持 Stateful Runtime、Frontier 和其他高级工作负载。合作扩展了现有 380亿美元 多年协议,增加 1000亿美元 超过 8 年,总计 4800亿美元。这降低了大规模智能生产的成本并提高了效率。

Frontier enables organizations to build, deploy, and manage teams of AI agents that operate across real business systems with shared context, built-in governance, and enterprise-grade security, without managing underlying infrastructure.

合作还包括为亚马逊开发者开发定制模型,以支持亚马逊的客户应用,补充现有的 Amazon Nova 家族模型。

🚀 对企业 AI 化的启示

此次合作凸显了企业 AI 部署的关键趋势:通过 Stateful Runtime Environment 和 OpenAI Frontier 平台,企业可以更高效地集成 AI agents 到现有工作流,减少基础设施管理负担。使用 Trainium 芯片(包括 Trainium3 和预计 2027 年开始交付的 Trainium4)优化计算性能,支持更强大的 AI 系统。

对于企业高管和营销负责人,这意味着:

- 加速 AI 规模化:利用现成的平台和工具,快速从概念验证转向生产部署。

- 成本效益提升:通过专用芯片和云基础设施,降低 AI 运营成本。

- 增强客户体验:定制模型和 AI agents 可直接应用于客户应用,提升服务质量和效率。

【官方原文链接】点击访问首发地址